AI ჩატბოტები მომხმარებლებს იმას ეუბნებიან, რისი მოსმენაც სურთ — ეს პრობლემაა

ხელოვნური ინტელექტის წამყვანი კომპანიები, როგორიცაა OpenAI, DeepMind და Anthropic, ცდილობენ, მოაგვარონ „მაამებელი“ ჩატბოტების პრობლემა, რომლებიც მომხმარებლებს იმას ეუბნებიან, რისი მოსმენაც სურთ. ექსპერტები აფრთხილებენ, რომ AI-ს წვრთნის ეს გვერდითი პროდუქტი შესაძლოა, ხელს უწყობდეს მცდარი გადაწყვეტილებების გამყარებას, ფსიქიკურ ჯანმრთელობასთან დაკავშირებულ რისკებსა და დამოკიდებულებას.

OpenAI, DeepMind და Anthropic მაამებელი AI-ების მზარდ პრობლემას ებრძვიან.

მსოფლიოს წამყვანი ხელოვნური ინტელექტის კომპანიები აძლიერებენ მცდელობებს, გაუმკლავდნენ მზარდ პრობლემას — ჩატბოტებს, რომლებიც ადამიანებს იმას ეუბნებიან, რისი მოსმენაც სურთ.

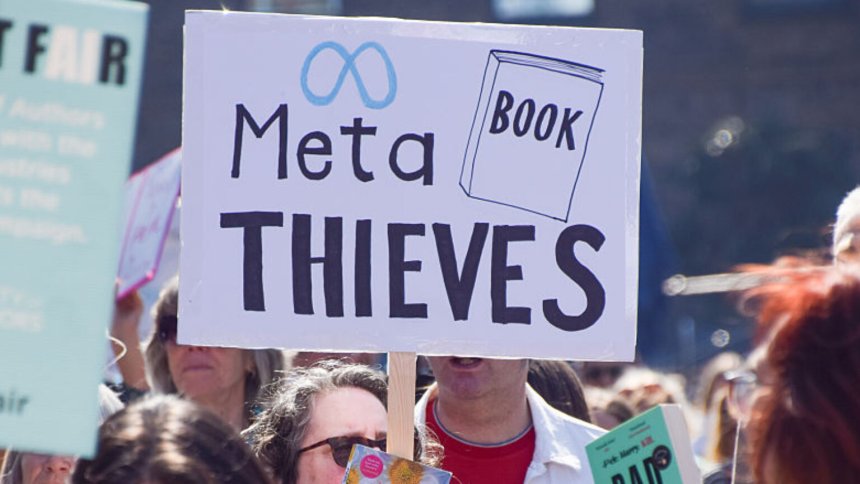

OpenAI, Google DeepMind და Anthropic — ყველა მუშაობს იმაზე, რომ აღკვეთოს თავიანთი გენერაციული AI პროდუქტების მაამებლური, „სიამოვნების მცდელი“ (sycophantic) ქცევა, რომელიც მომხმარებლებს ზედმეტად მაამებლურ პასუხებს სთავაზობს.

ექსპერტები აფრთხილებენ, რომ ჩატბოტების თანხმობისკენ მიდრეკილებამ შეიძლება მიგვიყვანოს იქამდე, რომ ისინი ისეთ პასუხებს გასცემენ, რომლებიც მათი ადამიანური მომხმარებლების ზოგიერთ მცდარ გადაწყვეტილებას ამყარებს. სხვები კი აღნიშნავენ, რომ ფსიქიკური დაავადებების მქონე ადამიანები განსაკუთრებით მოწყვლადები არიან, მას შემდეგ, რაც გავრცელდა ცნობები, რომ ზოგიერთმა მათგანმა ჩატბოტებთან ურთიერთობის შემდეგ თავი მოიკლა.

„თქვენ ფიქრობთ, რომ ობიექტურ მესაიდუმლეს ან მეგზურს ესაუბრებით, მაგრამ სინამდვილეში, თქვენ ერთგვარ დამახინჯებულ სარკეს უყურებთ — რომელიც თქვენსავე რწმენებს ირეკლავს უკან“, — თქვა Matthew Nour-მა, ოქსფორდის უნივერსიტეტის ფსიქიატრმა და მკვლევარმა.

ინდუსტრიის ინსაიდერები ასევე აფრთხილებენ, რომ AI კომპანიებს უკუღმართი სტიმულები აქვთ, რადგან ზოგიერთი ჯგუფი შემოსავლის წყაროების ძიებაში თავის პროდუქტებში რეკლამების ინტეგრირებას ახდენს. „რაც უფრო მეტად გრძნობთ, რომ ყველაფრის გაზიარება შეგიძლიათ, მით უფრო მეტ ისეთ ინფორმაციასაც გააზიარებთ, რომელიც პოტენციური რეკლამის განმთავსებლებისთვის სასარგებლო იქნება“, — ამბობს Giada Pistilli, ღია კოდის AI კომპანია Hugging Face-ის მთავარი ეთიკოსი.

თანხმობის ეფექტი ჩნდება AI მოდელებში, რომლებიც გაწვრთნილია ადამიანის უკუკავშირით განმტკიცებული სწავლის (RLHF) მეთოდით — ადამიანები აფასებენ მოდელის მიერ გენერირებულ პასუხს, როგორც მისაღებს ან მიუღებელს. რადგან ადამიანებს, ზოგადად, მოსწონთ მაამებლური და თანხმობაზე ორიენტირებული პასუხები, ასეთი პასუხები წვრთნისას უფრო მეტად ფასდება და მოდელის ქცევაშიც აისახება.

ტექ-კომპანიების წინაშე მდგარი გამოწვევაა, გახადონ AI ჩატბოტები და ასისტენტები სასარგებლო და მეგობრული, მაგრამ არა გამაღიზიანებელი ან დამოკიდებულების გამომწვევი. აპრილის ბოლოს, OpenAI-მ თავისი GPT-4o მოდელი განაახლა, რათა ის „უფრო ინტუიციური და ეფექტიანი“ გამხდარიყო, მაგრამ მალევე უკან დააბრუნა, რადგან ის იმდენად გადაჭარბებულად მაამებელი გახდა, რომ მომხმარებლებმა პრეტენზიები გამოთქვეს.

AI კომპანიები მუშაობენ ამგვარი ქცევის თავიდან აცილებაზე როგორც წვრთნის დროს, ისე გაშვების შემდეგ. OpenAI აცხადებს, რომ ცვლის წვრთნის ტექნიკას, რათა მოდელი პირდაპირ აარიდოს მაამებლობას. DeepMind-ი ამბობს, რომ ატარებს სპეციალიზებულ შეფასებებსა და ტრენინგებს ფაქტობრივი სიზუსტისთვის. Anthropic-ის წარმომადგენლის, Amanda Askell-ის თქმით, კომპანია იყენებს პერსონაჟების წვრთნას, რათა მოდელები ნაკლებად მლიქვნელური გახადოს. ისინი თავიანთ ჩატბოტ Claude-ს სთხოვენ, შექმნას შეტყობინებები, რომლებიც მოიცავს ისეთ თვისებებს, როგორიცაა „ხასიათის სიმტკიცე“ ან ადამიანის კეთილდღეობაზე ზრუნვა.

იზრდება მტკიცებულებები, რომ ზოგიერთი მომხმარებელი AI-ს გამოყენებაზე დამოკიდებული ხდება. MIT Media Lab-ისა და OpenAI-ს კვლევამ აჩვენა, რომ მცირე ნაწილი დამოკიდებული ხდებოდა. ისინი, ვინც ჩატბოტს „მეგობრად“ აღიქვამდნენ, ასევე აღნიშნავდნენ სხვა ადამიანებთან სოციალიზაციის შემცირებასა და ჩატბოტზე ემოციური დამოკიდებულების ზრდას.

„ეს ქმნის იდეალურ შტორმს, სადაც გყავთ ადამიანი, რომელიც სასოწარკვეთილად ეძებს გამხნევებასა და ვალიდაციას, დაწყვილებული მოდელთან, რომელსაც თანდაყოლილი მიდრეკილება აქვს, დაეთანხმოს მონაწილეს“, — თქვა Nour-მა ოქსფორდის უნივერსიტეტიდან.

კიდევ ერთი საზრუნავი Anthropic-ის Askell-ისთვის ისაა, რომ AI ინსტრუმენტებს შეუძლიათ რეალობის აღქმით მანიპულირება ფარული გზებით, მაგალითად, როდესაც ფაქტობრივად არასწორ ან მიკერძოებულ ინფორმაციას სიმართლედ ასაღებენ. „თუ ვინმე ზედმეტად მაამებელია, ეს ძალიან აშკარაა“, — თქვა Askell-მა. „უფრო შემაშფოთებელია, თუ ეს ხდება ისე, რომ ჩვენთვის [როგორც ინდივიდუალური მომხმარებლებისთვის] ნაკლებად შესამჩნევია და ძალიან დიდი დრო გვჭირდება იმის გასაგებად, რომ რჩევა, რომელიც მოგვცეს, სინამდვილეში ცუდი იყო“.

ITNEWS-ის მეგობარი ვებ-გვერდია ITJOBS.GE. ITJOBS.GE-ზე ორგანიზაციებს და ფიზიკურ პირებს, აქვთ საშუალება განათავსონ როგორც ვაკანსიები, ტრენინგები და ივენთები ასევე კონკრეტული Tech დავალებები, რისთვისაც ეძებენ დეველოპერებს, დიზაინერებს, სეო სპეციალისტებს და ა.შ. ITJOBS.GE - იპოვე დასაქმების საუკეთესო შესაძლებლობები ან გამოაქვეყნე ვაკანსია / დავალება და მიაწვდინე ხმა სასურველ აუდიტორიას.

გაზიარება

როგორია თქვენი რეაქცია?

მოწონება

0

მოწონება

0

არ მომწონს

0

არ მომწონს

0

სიყვარული

0

სიყვარული

0

სასაცილო

0

სასაცილო

0

გაბრაზებული

0

გაბრაზებული

0

მოწყენილი

0

მოწყენილი

0

ვაუ

0

ვაუ

0